当 Agent 成为主角,人类用什么界面保持控制权?

当 Agent 成为主角,人类用什么界面保持控制权?

王一川本文核心议题的思想素材,来源于一场由 GPT 与 Gemini 就「AI Agent 编程时代,GUI 界面与 CLI 命令行孰优孰劣」展开的多轮辩论。两个模型在辩论中的观点交锋与论证拆解,为本文提供了原始的论点矿藏;Claude 在此基础上对其进行了重新梳理、提炼与延伸,加入了独立判断,最终形成这篇技术博客。三个模型,一场关于接口范式的协作思考。

过去十年,GUI 和 CLI 的选择更多是个人偏好问题:初学者点按钮,专家敲命令,互不干涉。但当 AI Agent 开始承担越来越多的编程任务时,这个问题的性质变了。

它不再是”哪种工具更顺手”,而变成了:当 Agent 是主要执行者时,人类用什么界面来理解、控制和审计它的行为? 这是一个值得认真对待的工程问题。

问题的根源:角色反转

传统编程工作流的核心角色是人——人思考、人决策、人执行,工具只是手的延伸。CLI 或 GUI 的选择,本质上是在优化”人操作机器”的效率。

AI Agent 改变了这个前提。在典型的 Agentic 工作流中:

人类表达意图 → AI 拆解任务 → Agent 执行 → 人类审查结果 |

Agent 承担了大量原本属于人的”执行”环节。人的角色从操作者变成了意图定义者和决策审计者。

这个角色转变直接决定了接口的设计目标:我们需要的不再是”让人操作更高效的界面”,而是 “让人理解和控制 Agent 行为的界面”。两个目标,截然不同。

CLI 仍然是执行层的基石

先把一个事实说清楚:在 Agent 的执行层,CLI 没有竞争对手。

当 Agent 决定”修改配置文件”、”重启服务”、”运行测试”时,它生成的是命令,不是鼠标点击序列。这不是习惯问题,而是结构问题——LLM 的训练数据里充满了 shell 脚本、Python 代码和配置文件,它生成这些的准确率远高于”点击第三个菜单的第二个子项”。文本是 AI 的母语,这一点在工程上没什么好争的。

CLI 的优势在 Agent 时代反而被放大了:

可组合性。管道(pipe)是 Unix 哲学的核心,agent diagnose | jq '.anomalies[]' | agent fix 这样的组合,让 Agent 之间可以通过文本流协作,不需要任何共享 GUI。

可审计性。每条命令都有完整的执行历史。Agent 的每一步行动都可以被记录为结构化日志,可以 diff、可以 grep、可以在事后精确还原执行链路。这是 GUI 点击操作天生做不到的。

可靠性。SSH + CLI 是分布式系统的最后防线。浏览器崩溃、WebSocket 断开、网络分区——这些情况下,唯一可靠的应急通道是终端。任何只能通过 Web GUI 控制的 Agent 系统,本质上是一个单点故障。

但承认 CLI 是执行层的基石,并不等于说人类的日常交互也应该停留在 CLI。这是很多 CLI 信仰者容易犯的逻辑跳跃。

GUI 没有消失,但它必须进化

CLI 阵营有一个常见的批评:GUI 给的是 “被咀嚼过的二手认知” ,信息经过前端过滤、设计师筛选、浏览器渲染,早已失真。这个批评对旧 GUI 是成立的。

旧 GUI 的核心假设是:人类是主要操作者,界面的目标是降低操作门槛。所以它设计了按钮、表单、向导,把复杂操作简化成点击。这套逻辑在 Agent 时代确实过时了——如果 Agent 是主要操作者,为 Agent 设计一堆按钮是荒谬的。 但”旧 GUI 要死”不等于”GUI 这个概念要死”。

考虑这样一个场景:一个有 20 个子 Agent 协同运行的代码审查系统,某次 CI 出现了概率性失败。Agent 日志有 50,000 行,涉及 15 个 Agent 的交互,3 条决策链出现了策略切换。

你可以用 jq 查询——前提是你知道要查什么维度。但在生产事故中,最难的恰恰是这一步:你不知道问题在哪。

这就是 CLI 在”可发现性(Discovery)”上的先天弱势。CLI 是优秀的查询工具,但查询有个前提:你得先形成假设。在复杂的 Agent 系统中,从”系统异常”到”形成初步假设”这段路,靠 grep 走效率极低。

新范式的 GUI 要解决的,正是这个问题:

- 自动聚焦异常路径,而不是等人类主动发现

- 可视化 Agent 的推理链,让人类能验证 AI 的决策逻辑

- 在执行高风险操作前,展示影响范围而不仅仅是命令字符串

- 提供 Agent 行为的”回放”能力,用于事后复盘

注意这里的关键词:验证、审计、理解——而不是操作。这是 GUI 在 Agent 时代应有的定位,和过去的”操作入口”截然不同。

安全的真相:Policy as Code,而不是弹窗

GUI 阵营经常用一个例子来论证 GUI 的必要性:AI 把”清理无用数据”理解成了 rm -rf /data/*,GUI 可以在执行前展示风险、要求确认。

这个场景是真实的,但解决方案的选择值得商榷。

依赖 GUI 弹窗来防止危险操作,本质上是依赖人类注意力。人类注意力是不可靠的——深夜的告警、连续几小时的 oncall、疲惫状态下的”确定”点击,都是真实的事故来源。

更工程化的答案是 Policy as Code:

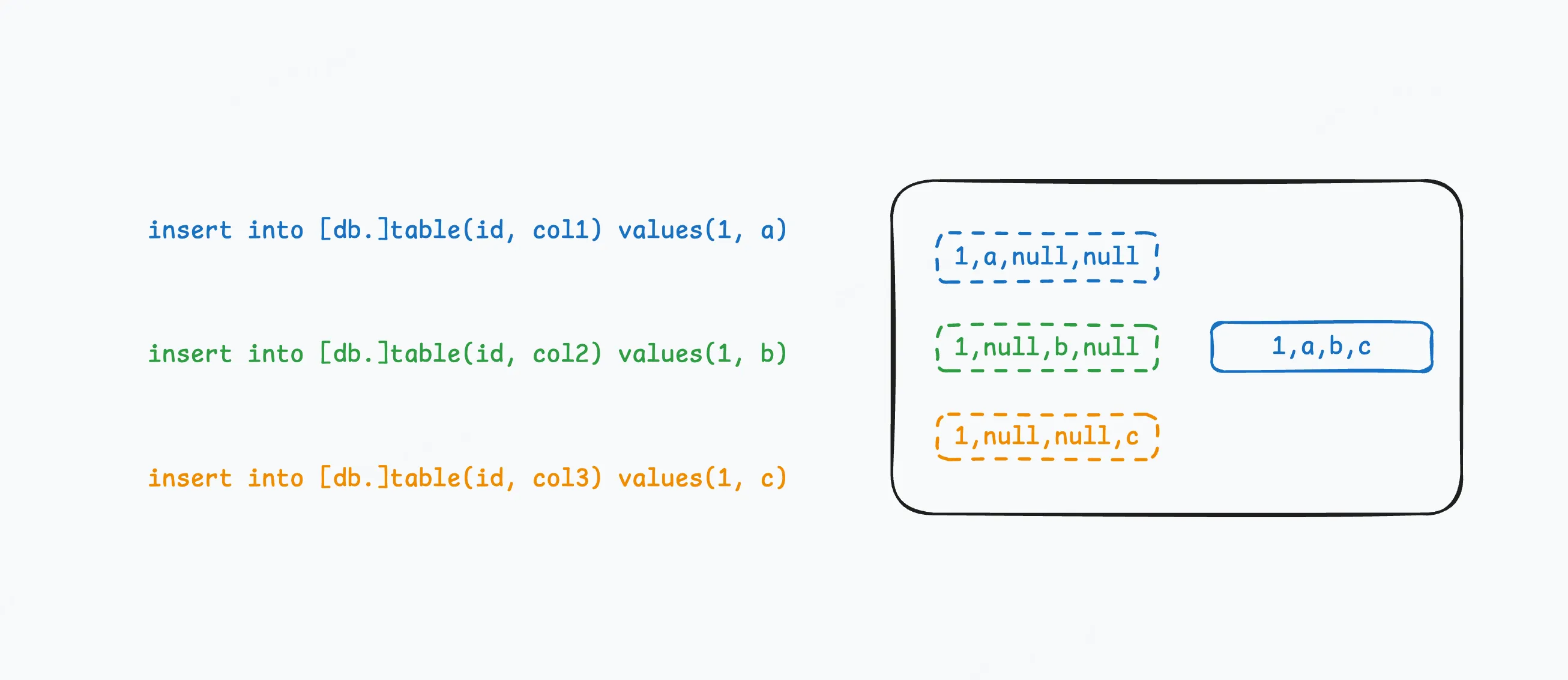

# safety-policy.yml |

这段策略代码可以被版本控制、代码审查、CI 自动验证,也可以被 Agent 在执行前自动匹配。它的防护是机械的、确定性的,不依赖任何人在凌晨三点还能保持专注。 当然,Policy as Code 和 GUI 并不互斥。好的工程实践是:用代码定义策略,用 GUI 可视化策略的覆盖范围和冲突路径——让人类理解策略的全局影响,而不是用 GUI 来执行策略。

TUI:一个被低估的答案

讨论到这里,有一个常被忽视的选项:TUI(Text-based User Interface)。

lazygit、k9s、lnav——这些工具同时具备了两个阵营都想要的东西:

- 实时可视化、交互式导航(GUI 的价值)

- 可脚本化、可管道、SSH 可达、不依赖浏览器(CLI 的价值)

k9s 的用户可以实时看到 Pod 状态、直接进入容器、查看日志——但所有这些都在终端里完成,意味着可以通过 SSH 在生产事故中远程使用,也意味着可以被自动化脚本调用。

这不是 GUI 赢了,也不是 CLI 赢了,而是说 “可视化”和”图形化”本来就是两个不同的需求。在 Agent 系统的运维场景中,需要的是前者,不一定需要后者。

一个更清晰的分层模型

综合两种视角,Agent 系统的接口应该是分层的,每层有不同的优化目标:

L3 意图层 │ 自然语言 ←→ 对话式 AI |

这个分层的关键洞察是:人类应该往上走(L3/L2),Agent 应该往下走(L0/L1)。两者在不同层各司其职,而不是争夺同一个层的主导权。

CLI 信仰者有时会说:既然有了 L3(自然语言/AI),L2(GUI)就是多余的中间层。这个逻辑有一定道理,但忽略了一个关键点——AI 的输出是概率性的,GUI 的可视化是确定性的。人类通过自然语言表达意图,AI 将其翻译为执行计划,然后人类需要一个界面来验证这个翻译是否准确。

“帮我清理过期数据”→ DELETE FROM logs WHERE created_at < '2024-01-01',这个翻译对不对?涉及多少条记录?影响哪些下游系统?这些判断需要可视化的辅助,不是再问一次 AI 就能解决的。

换一个视角:做 AI Coding,应该面向 CLI 还是 GUI 编程?

前面讨论的是”用什么界面控制 Agent”,但作为一名正在用 AI 辅助编程的程序员,还有一个角度同样值得认真对待:你在 AI 的帮助下写出来的代码,应该优先是 CLI 形态还是 GUI 形态?

这个问题的答案,直接影响你和 AI 的协作效率,也影响你的代码在 Agentic 工作流里能被利用到什么程度。

AI Coding 改变了代码的受众

传统编程里,代码只有一个受众:人。函数命名、接口设计、输出格式,一切都在优化”人类能否理解和使用”。

AI Coding 引入了第二个受众:Agent。你写的工具、脚本、函数,不只是你自己会用,也可能被 AI Agent 调用——用来完成更大任务的某个子步骤,或者在自动化流水线里被反复执行。

两个受众的偏好是不同的。人类喜欢直观的可视化界面;Agent 偏好文本化、结构化、可组合的接口。当你用 AI 帮你写代码时,隐含地决定了这段代码未来的受众结构。

执行逻辑:毫无争议,CLI 优先

对于业务逻辑、数据处理、工具脚本这类执行性代码,CLI 优先几乎是没有悬念的结论。

原因在于 Agent 的工作方式:它通过运行命令、读取输出、判断结果来推进任务。这个循环对文本输出天然友好,对像素输出几乎无能为力。一个输出结构化 JSON 的 CLI 工具,Agent 可以直接解析、判断、组合;同样功能的 Web UI,Agent 要用上去,要么依赖 DOM 解析,要么依赖屏幕截图 + OCR,成本高得不成比例。

这还带来了另一个实际好处:CLI 代码的 AI 迭代速度远快于 GUI 代码。AI 帮你写一个数据处理脚本,可以直接运行、读取输出、发现问题、修改、再运行,几秒一个循环,自主迭代到结果正确。帮你写一个 React 组件,验证”它是否正确工作”本身就是个难题——渲染、交互、视觉判断,每个环节都比”运行脚本读输出”复杂得多。这种效率差距不是偶然的,而是 CLI 的可测试性结构性优于 GUI 的必然结果。

观察与控制层:GUI 有其不可替代的位置

但如果把”CLI 优先”理解成”什么都做成命令行”,就又走偏了。

当 Agent 在帮你做一件复杂的事——比如重构一个核心模块,改动了十几个文件——你需要在接受之前审查这些变更。这时候你需要的不是更多的命令行输出,而是一个能让你以人类的方式理解正在发生什么的界面:哪些文件被改了、每处 diff 意味着什么、整体方向是否符合预期。

这正是 GUI 在 AI Coding 场景下真正有价值的地方——不是让你通过它来”操作”,而是让你通过它来”验证”。执行交给 Agent,理解和决策留给人。

所以更准确的表述是:执行逻辑 CLI 优先,控制与验证界面 GUI 优先。这不是折中,而是两件本来就应该分开的事。把业务逻辑写成可被 Agent 调用的 CLI 工具,同时为需要人类判断的环节保留清晰的可视化入口——这个分层,恰好也是本文一直在讨论的那个架构。

AI Coding 让好的架构决策变得更有回报

有意思的是,”CLI 优先的执行层 + GUI 控制验证层”这个架构,在 AI Coding 出现之前就是好的工程实践——它让代码更可测试、更可组合、更容易集成到自动化流水线。

AI Coding 只是放大了这个架构的收益:遵循它的代码,AI 可以更高效地理解、调用和迭代;不遵循它的代码,AI 帮你工作的效率会系统性地打折。

这意味着:在 AI 时代,好的架构决策会得到更快、更直接的反馈。你写了一个边界清晰、输出结构化的 CLI 工具,AI 立刻能高效地用起来;你写了一个把逻辑和 UI 耦合在一起的组件,AI 在帮你改它的时候就会明显更慢、更容易出错。

代码质量的回报周期,在 AI Coding 时代缩短了。

落地到日常:终端 Claude Code 还是 GUI 封装版?

前面的讨论多少还是偏抽象。让我们把它落到一个程序员每天都会面对的具体问题:同样是 Claude Code 这个 Agentic 工具,纯终端 CLI 模式和带可视化界面的 GUI 封装(VS Code 插件、Cowork 这类)有什么本质区别,我应该在什么时候用哪个?

这个问题其实是前面所有讨论的一次微缩版实验——相同的执行能力,不同的控制层,选择哪种取决于你当下需要的是”快速执行”还是”理解与验证”。

两者的真正差异:不是能力,是控制粒度

先澄清一个误区:终端版和 GUI 版的 Claude Code,底层执行能力完全相同——都能读文件、写代码、跑命令、调用工具。差异不在”能做什么”,而在你介入和审查的粒度。

终端 CLI 的工作节奏是流式的:你输入任务描述,Agent 开始执行,终端里滚动着命令和输出,完成后你看最终结果。整个过程是线性的,适合”我信任你,直接做”的场景。

GUI 封装的工作节奏是可视化分阶段的:你能看到文件树里哪些文件被标记为”待修改”,每次 diff 都以高亮形式呈现,你可以逐文件甚至逐块地 accept 或 reject,还能在执行的任意时刻暂停介入。这是”我想边看边确认”的场景。

这正好对应了本文一直在讨论的分层模型——CLI 是执行层,GUI 是控制与验证层。只不过在 AI Coding 工具里,这两层被集成在了同一个 Agent 能力上,你只是在选择以哪种方式介入。

用终端 CLI 模式的时机

任务边界清晰,且你高度信任执行结果。”帮我写这个模块的单元测试,覆盖率不低于 80%”——目标明确,验收标准客观(跑一下 coverage 就知道对不对)。这类任务让 Agent 自主跑完,你看最终结果就够了,不需要盯着每一步。

需要和其他 CLI 工具组合。终端模式可以无缝接入 shell 工作流:把 Claude Code 的输出管道给 jq,把某个脚本的执行结果直接作为下一个 Claude Code 任务的上下文,或者在 Makefile、CI 脚本里调用它。GUI 封装版本通常是独立窗口,这种组合性会受到限制。

在远程服务器或 SSH 环境里工作。修复线上环境的配置问题、在服务器上调试部署脚本——这些场景根本没有 GUI 可用,终端是唯一选项。能用终端稳定运行 Claude Code,是这类场景的基本盘。

反复执行的自动化任务。把 Claude Code 的调用写进脚本,定期执行代码质量检查、自动生成变更日志、批量处理某类重复性工作——这是只有 CLI 才能给你的能力,GUI 没有”脚本化”的路径。

你处于深度终端工作流中。如果你本来就在终端里,vim 或 neovim 开着,tmux 分屏——强行切换到 GUI 窗口反而打断了节奏。终端内的 Claude Code 能直接读取你当前工作目录、最近的 git 状态、刚刚跑失败的测试输出,上下文天然完整。

用 GUI 封装版的时机

涉及多文件改动,你需要逐一审查。重构一个核心模块可能同时改动十几个文件。GUI 的文件树视图让你一眼看到哪些文件被动了,diff 高亮让你对每处修改做出判断,而不是在终端里滚动着看一大段 patch 输出,再试图在脑子里还原改了什么。这正是本文反复强调的”可验证性”——在 AI 输出落地之前,你需要一个界面来确认它的翻译是否准确。

任务风险较高,你想保持细粒度控制。修改核心业务逻辑、调整数据库 schema、改动权限相关的代码——这些改动一旦出错成本很高。GUI 的逐块 accept/reject 能力让你在不打断 Agent 整体执行节奏的前提下,对每一处高风险修改单独把关,而不是只能选择”全接受”或”全拒绝”。

你需要理解 Agent 的推理过程,而不只是结果。GUI 封装版通常会把 Agent 的执行步骤、工具调用、中间思考过程以更结构化的方式呈现出来。当 Agent 做出一个不符合你预期的决策时,这个可视化的执行轨迹会帮你快速定位是哪一步出了偏差——是任务描述不够清晰,还是 Agent 理解有误,还是某个工具调用返回了异常结果。

和团队成员协作审查 AI 生成的代码。GUI 提供的可视化 diff 和注释能力,让”AI 写的代码交给人类 review”这个流程变得自然——和 code review 的既有工作流对齐,而不是把一段命令行输出发给同事让他自己理解发生了什么。

项目初期,不确定性高。刚开始在一个陌生代码库里工作,或者任务本身的边界还不清晰——这时候 GUI 的”边看边做”比 CLI 的”做完再看”更适合,能帮你在过程中不断校准方向,而不是跑完一大段再发现跑偏了。

一个简单的选择框架

这次任务,我需要边执行边审查吗? |

还有一种值得推荐的混合节奏:用 GUI 版完成有风险、需要逐步确认的探索阶段,切换到终端 CLI 跑那些已经验证过思路的重复性任务。GUI 是你理解系统的窗口,CLI 是你提速执行的引擎,两者不是竞争关系,而是不同阶段的最优选择。

给工程实践的建议

对于用 AI 辅助编程的工程师:

给每个核心工具加上 --format=json 输出选项,让 AI Agent 可以直接解析结构化结果而不是做文本匹配。遵守 Unix 退出码惯例(成功返回 0,失败返回非零),让 AI 能可靠地判断操作是否成功。尽可能为破坏性操作提供 --dry-run 模式——这不只是给人类的安全网,也是 Agent 自主验证意图的标准路径。

对于构建 Agent 系统的工程师:

执行层无条件用 CLI/API,不要让 Agent 的操作依赖 GUI 状态。所有 Agent 的行为都应该产生结构化的可查询日志,而不只是渲染到面板上就消失。

为系统设计 TUI 级别的运维工具,而不是 Web Dashboard——前者在生产事故中更可靠,SSH 可达,不依赖任何额外的网络路径。

对于设计 Agent 控制面的产品/工程师:

放弃”操作入口”的设计思路,转向”验证与审计”。用户不需要在 GUI 里”配置 Agent”,他们需要的是理解 Agent 正在做什么、为什么这么做、下一步会影响什么。

把 Policy as Code 放在真正执行防护的位置,GUI 只是让策略变得可理解的辅助层。

对于整个团队:

任何系统都应该有 CLI 级别的应急预案。如果某个关键操作只能通过 GUI 完成,这是一个应该在设计阶段消除的风险,不是运维时才发现的问题。

结语

GUI vs CLI 的争论,在 AI Agent 时代其实是个伪命题。真正的问题是:在 Agent 高度自治的环境下,人类如何保持对系统的真实理解和有效控制?

CLI 给了 Agent 一个精确、可组合、可审计的执行环境。新范式的 GUI 给了人类一个理解、验证、约束 Agent 行为的控制面。两者服务于不同的目标,缺一不可。

如果一定要用一句话来概括:CLI 是 Agent 的手,AI 是翻译官,GUI 是人类的眼睛。工程师的任务,是让这三者在正确的层位上各司其职——而不是让其中任何一个试图包办全部。

当 Agent 越来越强大,系统越来越复杂,人类被排出控制环的风险会越来越真实。对抗这个风险的方式,不是拒绝 Agent 的自治,而是认真设计每一层的接口,让人类始终有能力在需要的时候理解并接管系统。

这才是这场争论真正有价值的地方。